Источник: rb.ru

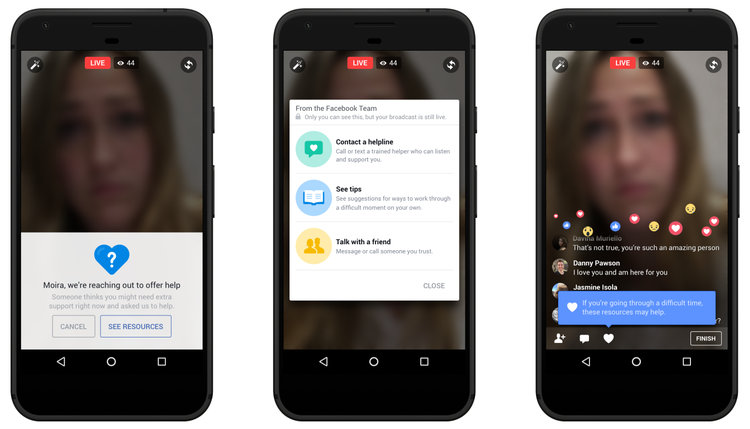

Компания Facebook расширит функцию автоматического выявления суицидальных постов для оперативной помощи пользователям по всему миру. Об этом пишет TechCrunch.

Софт на основе искусственного интеллекта начнет анализировать все посты в соцсети, чтобы вовремя передать данные о риске суицида модераторам Facebook и соответствующим организациям. Система предложит пользователям связаться с центрами психологической помощи или друзьями и покажет рекомендации психологов.

Система также уведомит друзей пользователя о его состоянии.

В Facebook пояснили, что алгоритм может находить ключевые фразы и образы на картинках и видео, посты с которыми другие пользователи ранее отмечали как потенциально суицидальные. Система также сможет искать посты, где в комментариях есть фразы вроде «ты в порядке?» и «нужна ли тебе помощь?». Другие подробности работы алгоритма в компании не раскрыли.

Facebook также увеличит число модераторов, работающих с суицидальными постами и повысит приоритет «экстренных» обращений пользователей. Сейчас компания уже заключила соглашения о партнерстве в этой сфере с 80 организациями, которые занимаются срочной психологической помощью.

Ранее эта функция тестировалась только в пределах США, в самой Facebook тесты назвали успешными, отмечает Reuters.

«Это направлено на то, чтобы сохранить минуты на каждом этапе [реагирования], особенно если речь о [сервисе прямых трансляций] Facebook Live. За последний месяц Facebook инициировала около 100 “профилактических проверок”, когда сотрудники соответствующих служб посещали пользователей. Были случаи, когда люди приходили, а пользователь еще вел трансляцию», – передает TechCrunch слова вице-президента по продукту в Facebook Гая Розена (Guy Rosen).

Представитель Facebook в разговоре с изданием не стал отвечать на вопрос о том, собирается ли соцсеть использовать эти технологии для выявления других постов – например, политической или криминальной направленности.

Самые актуальные новости - в

Самые актуальные новости - в